Vor ein paar Jahren, als ich als Lehrassistent für einen Numerikkurs auf UNM arbeitete, musste ich bei vielen Gelegenheiten mehreren verwirrten Studierenden die Normalengleichungen erläutern, also die modifizierte Matrix-Vektor-Gleichung $A^\ast A \mathbf{x} = A^\ast\mathbf{b}$, durch der man die Least-Squares-Lösung einer überbestimmten Gleichung $A\mathbf{x} = \mathbf{b}$ rechnet, wenn keine exakte Lösung zu finden ist. Es gibt tatsächlich eine schöne und einfache geometrische Erläuterung sowohl für diese Gleichung als auch für die etwas geheimnisvoll aussehende Pseudoinverse $(A^\ast A)^{-1} A^\ast$ einer Matrix.

Kürzlich ist mir eingefallen, als ich noch mal auf dieses Thema in einem Statistikkurs zurückgekommen bin, dass ich diesen Gedankengang nicht einmal niedergeschrieben habe. Ob oder wie sehr diese Intuition den Studierenden tatsächlich geholfen hat, bin ich immer noch nicht ganz sicher, aber in diesem Blogeintrag lege ich sie schriftlich dar, selbst wenn nur für meinen Eigenbedarf.

Die Least-Squares-Lösung zur Gleichung $A\mathbf{x} = \mathbf{b}$ ist, per Definition, der Vektor $\mathbf{x}^\ast$, der die Distanz $\lVert A\mathbf{x} - \mathbf{b}\rVert_2$ minimiert. Natürlich ist es nicht (unbedingt) eine Lösung der Gleichung $A\mathbf{x} = \mathbf{b}$, da $\mathbf{b}$ sich vielleicht überhaupt nicht im Spaltenraum der Matrix $A$ sitzt. Die entscheidende Einsicht zur Rechnung der Least-Squares-Lösung lautet, dass der Fehlervektor $A\mathbf{x} - \mathbf{b}$ orthogonal zum Spaltenraum $\text{col}(A)$ sein muss.

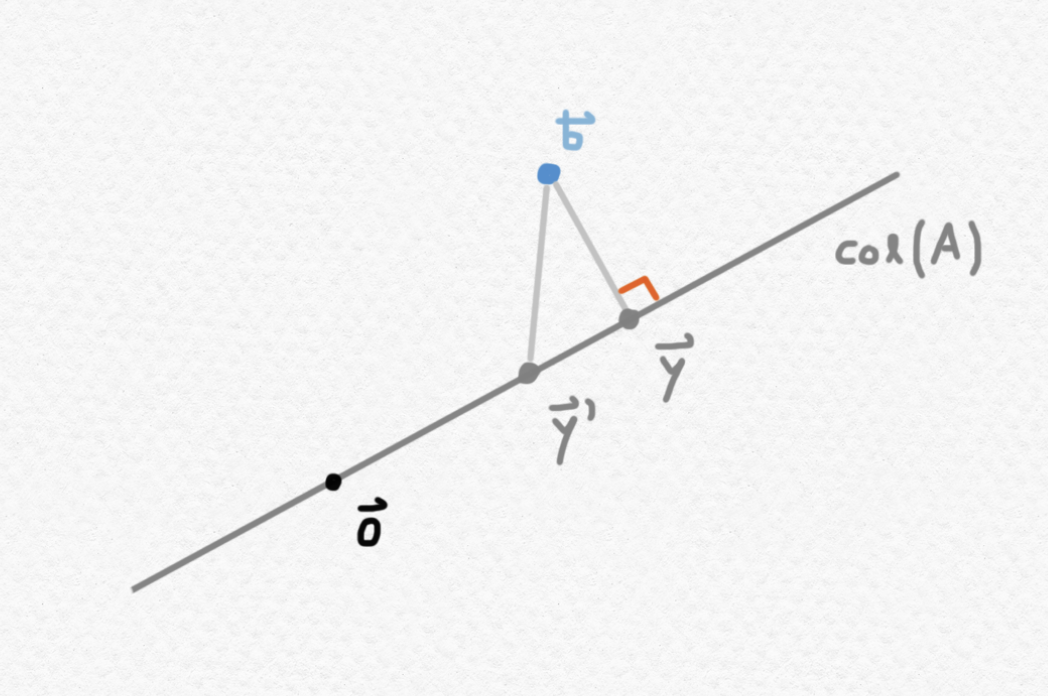

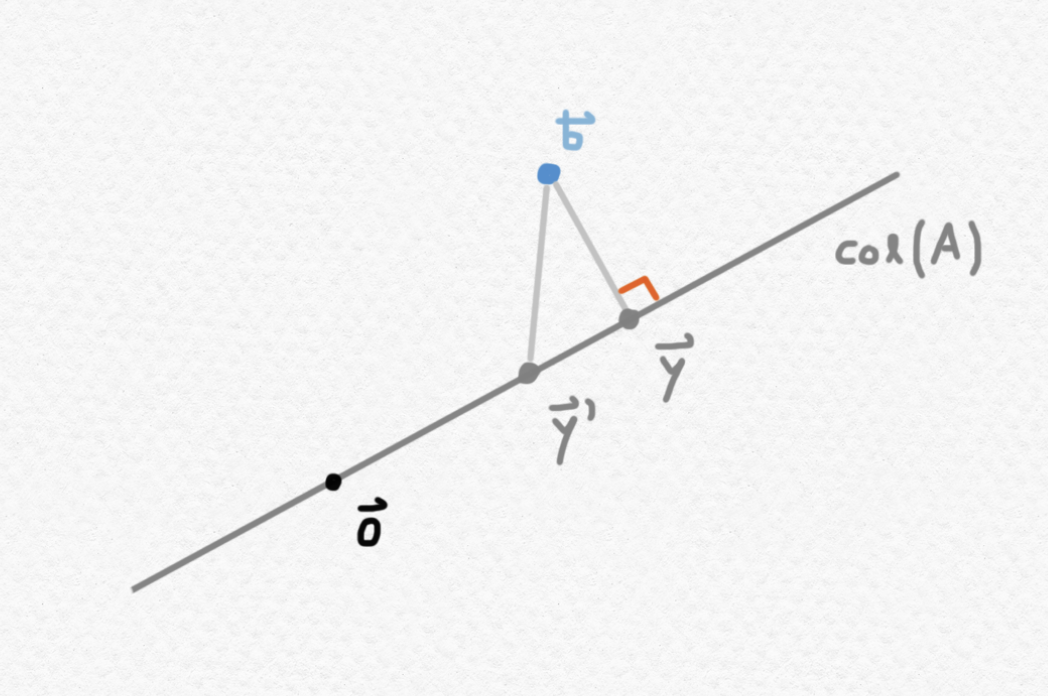

In einer zweidimensionalen Ebene kann mann diese Tatsache ganz intuitiv auf einen Blick erfassen. Stell dir mal vor, dass $\mathbf{y}=A\mathbf{x}$ die Projektion von $\mathbf{b}$ in den Spaltenraum von $A$ ist, damit $\mathbf{b}-\mathbf{y}$ dazu orthogonal ist, und dass $\mathbf{y}'=A\mathbf{x}'$ ein anderer Punkt im Spaltenraum von $A$ ist, also ein alternativer Kantidat für die Least-Squares-Schätzung. Dann sieht die Situation so aus:

Mithilfe des Satzes des Pythagoras können wir folgern, dass $\lVert \mathbf{b}-\mathbf{y}' \rVert^2 = \lVert \mathbf{b}-\mathbf{y} \rVert^2 + \lVert \mathbf{y}-\mathbf{y}' \rVert^2$ und deshalb, dass $\lVert \mathbf{b}-\mathbf{y}' \rVert > \lVert \mathbf{b}-\mathbf{y} \rVert$, also $\mathbf{y}'$ steht tatsächlich ferner vom Zielpunkt $\mathbf{b}$ als $\mathbf{y}$.

Also: wenn $\mathbf{x}$ die wahre Least-Squares-Lösung ist, dann soll $A\mathbf{x} - \mathbf{b}$ orthogonal zu $\text{col}(A)$ sein. Das heißt: $A\mathbf{x} - \mathbf{b}$ muss orthogonal zu jeder Spalte von $A$ sein. Durch Linksmultiplikation mit der Matrix $A^\ast$ rechnet man das Skalarprodukt von einem Vektor mit jeder Spalte von $A$, was genau der Nullvektor produzieren soll, wenn dieser Eingabevektor orthogonal zu jeder Spalte von $A$ ist. Deshalb erfüllt die Least-Squares-Lösung die folgende Gleichung: oder: Beachte, dass selbst wenn $A$ keine Quadratmatrix ist, also die Dimensionen $m\times n$ mit $m\neq n$ hat, muss $A^\ast A$ die dimensionen $n\times n$ haben, also eine Quadratmatrix sein. Wenn $A^\ast A$ zudem eine invertierbare Matrix ist, also wenn die Spalten von $A$ linear unabhängig sind, dann können wir weiterhin folgern: Deshalb nennt man die Matrix $(A^\ast A)^{-1} A^\ast$ die Pseudoinverse von $A$: wenn $A$ invertierbar ist ergibt Linksmultiplikation mit der Inverse $A^{-1}$ die Lösung zur Gleichung $A\mathbf{x} = \mathbf{b}$, aber wenn $A$ gar keine Quadratmatrix ist aber vollen Spaltenrang hat, dann ergibt Linksmultiplikation mit $(A^\ast A)^{-1} A^\ast$ die Least-Squares-Lösung der selben Gleichung. Wenn $A$ invertierbar ist stimmen diese Definitionen natürlich überein, da der Ausdruck $(A^\ast A)^{-1} A^\ast$ in diesem Fall auf $A^{-1}$ simplifiziert werden kann.